DGX Spark przetestowany! 128 GB pamięci i 1 PFLOP – idealne narzędzie do nauki i badań

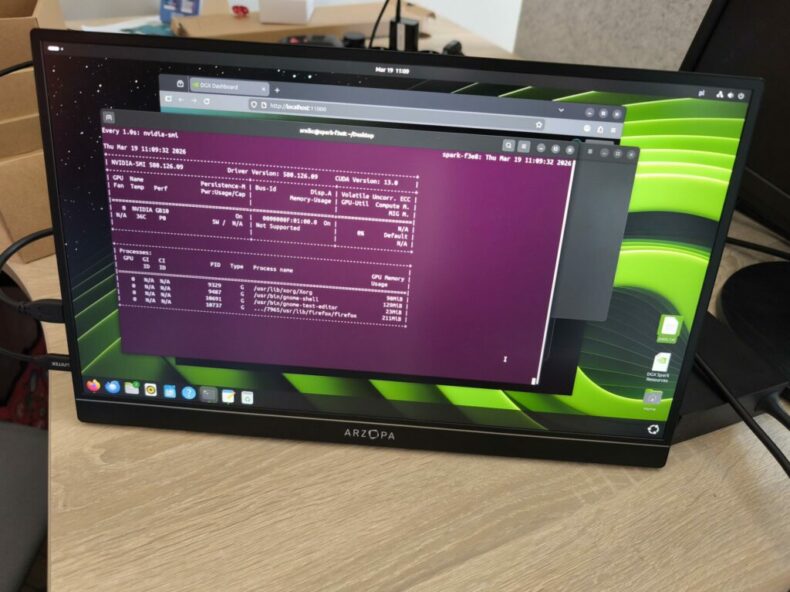

Przez ostatnie dwa tygodnie mieliśmy wyjątkową możliwość testowania NVIDIA DGX Spark – kompaktowego desktopowego superkomputera AI opartego na architekturze Grace Blackwell (GB10). To narzędzie, nazywane przez NVIDIA „AI supercomputer on your desk”, trafiło do Sekcji Rozwoju Narzędzi i Kompetencji Cyfrowych naszego Uczelnianego Centrum Informatycznego, co pozwoliło nam sprawdzić jego możliwości bezpośrednio na uczelni.

Już po krótkim okresie testów zauważyliśmy duży potencjał tego rozwiązania zarówno w pracach naukowych, jak i w codziennym wsparciu administracji oraz dydaktyki. DGX Spark umożliwia lokalne uruchamianie zaawansowanych modeli AI bez konieczności korzystania z chmury, co jest szczególnie cenne pod względem bezpieczeństwa danych, kosztów i niezależności.

W tak krótkim czasie udało nam się przetestować kluczowe funkcjonalności urządzenia – od uruchamiania dużych modeli językowych (LLM), przez fine-tuning, po eksperymenty z wnioskowaniem (inference). Wyniki są bardzo obiecujące: DGX Spark okazał się idealnym narzędziem do prac badawczych w dziedzinach takich jak uczenie maszynowe, przetwarzanie języka naturalnego, analiza danych czy symulacje obliczeniowe. Dzięki zintegrowanemu środowisku NVIDIA (DGX OS, CUDA, NIM, vLLM, TensorRT-LLM, Ollama i inne) setup jest prosty i gotowy do natychmiastowego użycia.

Specyfikacja techniczna NVIDIA DGX Spark

- Architektura: NVIDIA GB10 Grace Blackwell Superchip

- Procesor (CPU): 20-rdzeniowy Arm (10× Cortex-X925 + 10× Cortex-A725)

- GPU: Architektura Blackwell z Tensor Cores 5. generacji i RT Cores 4. generacji

- Wydajność AI: do 1 PFLOP (1000 TFLOPS) w precyzji FP4 (z wykorzystaniem rzadkości)

- Pamięć: 128 GB LPDDR5x zunifikowanej, spójnej pamięci (unified system memory) – dostępna jednocześnie dla CPU i GPU, przepustowość 273 GB/s

- Pamięć masowa: 4 TB NVMe M.2 z samo-szyfrowaniem

- Sieć: ConnectX-7 Smart NIC, 10 GbE, Wi-Fi 7, Bluetooth 5.4

- Wymiary: bardzo kompaktowe – 150 × 150 × 50,5 mm

- System operacyjny: DGX OS (oparte na Ubuntu z pełnym stackiem NVIDIA AI)

Jakie modele LLM można uruchomić na DGX Spark?

Dzięki 128 GB zunifikowanej pamięci DGX Spark radzi sobie znakomicie z dużymi modelami językowymi. W praktyce możliwe jest uruchamianie modeli o parametrach do około 200 miliardów (w precyzji 4-bit/FP4 lub FP8/MXFP4), a przy wykorzystaniu dodatkowych mechanizmów (np. multi-node lub NVLink) nawet większych.

Przykłady modeli, które udało nam się testować:

- gpt-oss-120B

- Nemotron-3-Super-120B (FP8)

- Llama-3.1-8B-Instruct

- Qwen3 / Qwen2.5

- DeepSeek

Urządzenie świetnie współpracuje z narzędziami takimi jak:

- Ollama

- vLLM

- TensorRT-LLM

- NVIDIA NIM

- LM Studio

Dzięki temu można szybko uruchomić lokalny serwer inferencji, fine-tunować modele na własnych danych lub prowadzić eksperymenty badawcze bez wychodzenia poza infrastrukturę uczelni.

Podsumowując – DGX Spark to narzędzie, które może znacząco wspomóc naszą działalność naukową i administracyjną. Już teraz widzimy potencjał w projektach badawczych, wsparciu studentów oraz automatyzacji procesów uczelnianych.